ゲス顔イオナズン

Stable Diffusion✕AIイラスト徹底解説!

レタッチ(inpaint)機能が理解る!修正&入れ替え徹底解説こんばんは、スタジオ真榊です。今夜の記事は、image2imageを画像の一部だけに掛けて修正できる「レタッチ機能」についてです!設定値と生成結果が直感的に結びつきにくいので、みんななんとなく体感でなんとかしている(そしてたいていなんとかならない…)のが、このレタッチ機能。いろいろな実験結果と共に、ようやく理解できた設定の使い分けや活用法について紹介していければなと思います。

「レタッチ機能でこんな事ができるよ!」という動画を作ってみたので、まずはこちらをどうぞ。

この動画では、レタッチ機能を使って背景の描き直し、余計な被写体の除去、小物の置き換え、表情チェンジといった作業を行っています。誰でも再現できるように、レタッチの基本的考え方や具体的操作方法を解説していきたいと思います。AIイラストの動画化のやり方も後半に紹介します! 目次レタッチ(inpaint)の基本 ノーモア色移り?プロンプトの影響範囲を操作しよう!こんばんは、スタジオ真榊です。今日はレタッチ機能の掘り下げ記事を更新する予定だったのですが、新たに公開された拡張機能が非常にエキサイティングな内容だったため、順番を差し替えてお送りします!

今回登場したのは、プロンプトの影響を狭めて色移りを起こりにくくしてくれるという拡張機能「sd-webui-cutoff」。

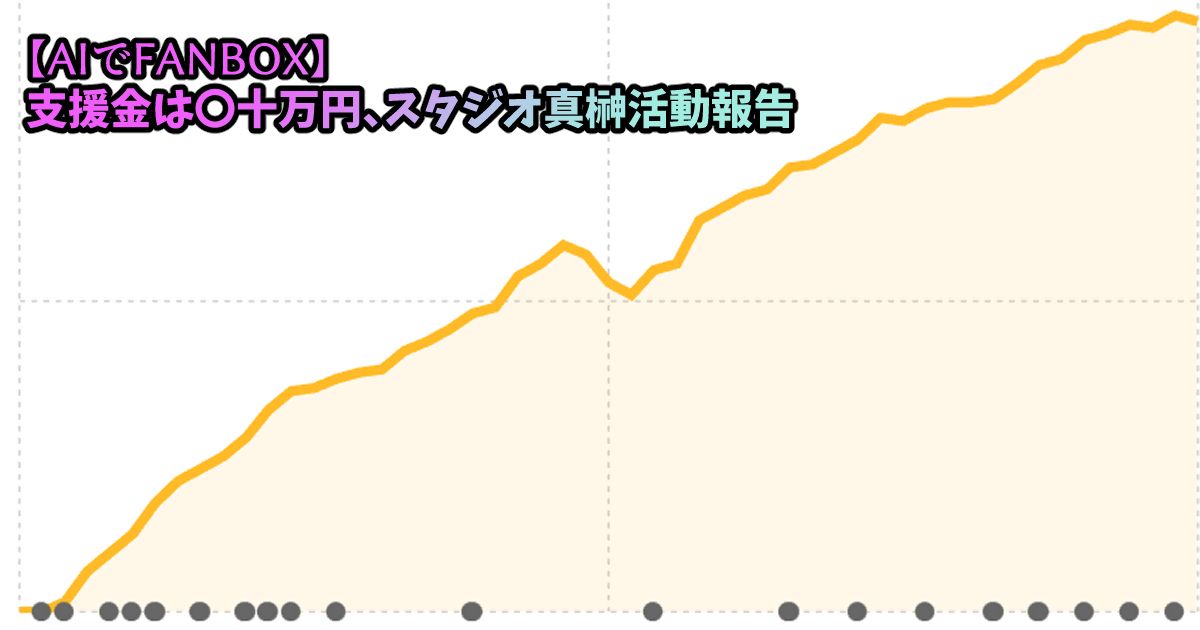

どういう仕組みなのか?どんな効果が得られるのか?色移り防止以外にも応用できるのか?ということで、さっそくあれこれ実験してみたのでご報告したいと思います。 【全体公開】今から追いつく!AIイラスト超入門こんばんは、スタジオ真榊です。このところ、ツイッター経由で公式サイトやこちらのFANBOXへのアクセスが急増しており、これからAIイラストを始めたいという方からのグラフィックボードや導入方法についての質問をお受けすることが増えてきました。そこで今夜は、これまでのFANBOX記事を振り返りつつ、画像生成AIを今から最短距離で学ぶための記事を全体公開で書いてみたいと思います。 スタジオ真榊のFANBOXもほとんど毎日更新といった趣で、日々StableDiffusionWebUI絡みの進化を追っているのですが、既に過去記事もかなりの量となり、どれから読んだらいいのかも分かりにくくなりつつあります。素敵なイラストを思い通りに生成するために覚えるべきことを紹介しつつ、参照すべき過去記事とセットで解説していければと思います。 目次画像生成AIの仕組みをざっくり解説

「StableDiffusionWebUI」とは

必要なマシンスペック

画像生成に必要な基礎知識

- ①Checkpoint(学習モデル)

- ②VAE

- ③プロンプトとネガティブプロンプト

- ④ステップとスケール

- ⑤サンプリングアルゴリズム(サンプラー)

- ⑥SEED値

インストール後にやるべきこと

Checkpointはどこで入手する?

実際にイラストを生成してみよう

生成した画像は必ず取っておこう

image2imageしてみよう

【重要】AI術師がやってはいけないこと

中級者になるために

終わりに AIでカラーイラストから線画を抜き出してみよう!こんばんは、スタジオ真榊です。今夜は前回に続き、AIイラストと線画についての記事です。前回は線画に着色するやり方でしたが、今日は逆手順で「カラーイラストを線画化する方法」について紹介していきます。 単に主線を抜き出して線画化するだけでなく、ラフスケッチ調にしたり、鉛筆書き風に仕上げることも可能。主線を抜き出して元のイラストに重ねると、また違った表現になりますし、逆に主線を抜き出しておかしいところを線画レベルで修正し、それを新たにAIで着色する…といった今までにない手法もできるわけです。さっそく具体的手順を見ていきましょう! AIを使って「線画に色塗り」をしてもらおう!【StableDiffusionWebUI】こんばんは、スタジオ真榊です。今夜はこちらのツリーでも紹介した、線画を使ったAIイラスト生成についての記事です!線画にAIで着色するために必要ないろいろなTIPSや、controlnetの各種設定の方法、線画をできるだけそのままにしながらリッチにスケールアップする方法など、実用的な技術について解説できればと思います。

【ゲームエンド!?】controlnet拡張で手の描写を支配しよう!こんばんは、スタジオ真榊です。なぜか本日突如として7年間続いたシャドウバンが解けまして、ツイッター上でたくさん通知が来て楽しい一日を過ごせました笑 18禁アカウントなのにいいんですかねイーロンさん…

さて、本日は非常にエキサイティングなControlnetの拡張機能が登場しましたので、さっそく実験をしてみました。「sd-webui-depth-lib」は、多数の手の形をしたdepthマップをWebUI上で拡縮・回転・反転させて、手の形を強く傾向付けられる画期的機能です!

【無料公開版】超革命!「Multi Controlnet」でできるようになったことこんばんは、スタジオ真榊です。前回は「Segmentation」を使った構図コントロールのやり方について紹介しましたが、今夜は「canny」や「depth」なども含め、最新のControlNetをフルに使うと何が可能になるのかについて、かなり長文で取り上げていきたいと思います。久々の大型記事ですね!

<★FANBOX用の記事ですが、ブログでは前半部分までを無料公開いたします。全文はこちらから★>

ControlNetをめぐっては、「Controlnet徹底解説!プロンプト苦難の時代が終わる…」で紹介して以降も、日々精力的なアップデートが続いています。特に界隈で話題なのが「Multi Controlnet」ですよね。これ、同時に複数の抽出機能を使ってイラストを生成できる技術なのですが、本当にヤバイ聖杯中の聖杯です。触ったばかりだと「何に使えるのか分からない」「何と何をどう組み合わせればいいのか分からない」状態に陥りますが、使い方さえわかればAIと一気に仲良しになれます!

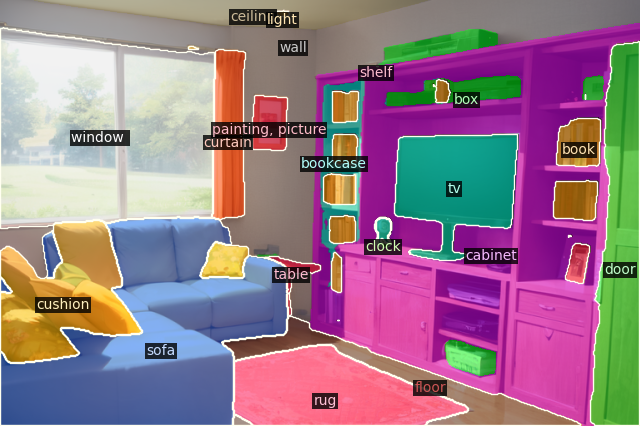

短期間に異次元の進化を遂げたControlnetで、具体的にどんなことが可能になったのか。さっそく見ていきましょう~! 【ControlNet革命】「Segmentation」で構図を支配しよう!こんばんは、スタジオ真榊です。このところAIと著作権をめぐる投稿が続いてしまったので、しばらくは本題に戻って、いつものStableDiffusionを使ったAIイラスト術について紹介していきたいと思います。今回はControlnet機能の一つ「Segmentation」の活用法についてです!

「ControlNet徹底解説!プロンプト苦難の時代が終わる…」でControlNetの各種機能については解説したところなのですが、前回は「Segmentation」だけ賢木の環境にうまく導入できず、説明を飛ばしてしまったんですよね。その後無事に活用できるようになったのですが、使えば使うほどに「Segmentationこそが構図を支配する聖杯…!」との思いを強くしたので、今回はじっくりその実力を確かめていきたいと思います。

Segmentationを導入しよう!さて、まずは前回のおさらいから。ControlNetは参考画像をもとにさまざまな情報を抽出して、それをもとに新たな絵を生成してもらうi2iの進化版のような機能でした。「Canny」は輪郭抽出、「Openpose」はボーン抽出、「Depth」は深度情報抽出、「Scribble」でラフ読み込み、「Fake scribble」はcannyよりおおまかな輪郭抽出…などなどが前回紹介した機能でしたが、今回紹介する「Segmentation」はこちらの画像のように、画面上のどこに何が描かれているかを自動認識して色分け指定する画期的な機能です!

▼導入方法

前回説明したのと同様、ControlNet-modules-safetensorsから「control_seg-fp16.safetensors」をダウンロードし、「stable-diffusion-webui\extensions\sd-webui-controlnet\models」フォルダに放り込めばOK。Controlnetの画面上で適当な画像を読み込ませ、Enableをオン、preprosessorを「segmentation」、モデルを「control_seg-fp16」にして画像生成してみましょう。他の学習セットと同様、初回生成時だけ読み込みに時間が掛かりますが、上の「塗り絵」のような画像が表示されれば成功です。

※うまくいかないときはcontrolnetをアップデートしてみましょう。初めてsegmentationを使う際、初回の画像生成前に「preview annotator result」ボタンを押すとエラー表示になるかもしれません。構わず一度画像生成してみてください。 【注意喚起】使用モデルのライセンスを再確認しよう!こんばんは、スタジオ真榊です。今日は学習モデルのライセンスをめぐって界隈がちょっとざわついた件をめぐる、「もう一回自分の使っているモデルのライセンスを確かめてみよう!」という注意喚起系の記事です。

このたび「ChilloutMIX」というフォトリアル系の人気モデルのライセンス表記が急に変更となったのですが、このモデルは先日レビュー記事でもご紹介したAbyssOrangeMix3にもマージ(混合)されており、派生モデルにも当然それが影響します。改めてそれぞれのモデルで何ができて、何ができないのかを確認したいと思います。 AI術師が知っておきたい著作権の話▼「イラスト無断転載事件」で考えるこんにちは、スタジオ真榊です。今回はStable diffusionの技術関連のお話ではなく、AIイラストの著作権とその侵害について、ツイッター上で起きた無断転載トラブルを振り返りながら考察したいと思います。

AI生成物の権利については、昨年11月に公式ブログの「【NovelAI】「生成イラストの権利は誰のもの?」徹底検証」でも紹介したところですが、その後ローカル環境での生成を多くのユーザーが楽しむようになり、さらにLoRAやControlnetといった全く新しい技術も浸透してきました。AIイラストを取り巻く状況はどんどん変化していますので、改めて2023年2月現在の状況を概観できればと思います。

(※本稿はAI術師界隈の司法関係者の方に監修していただきました) 【OpenPose Editor導入】もっと自由にポーズをつけよう!(ControlNet解説)こんばんは、スタジオ真榊です!

ControlNet、してますか?毎晩寝不足な日々が続いていますが、今夜は前回の「ControlNet徹底解説!プロンプト苦難の時代が終わる…」に続き、具体的なポーズの付け方についての実践編です。

ControlNet公開以来、特にキャラクターのボーン(骨組み)でポーズ指定できるOpenposeをより自由に設定する方法が次々に考案され、拡張機能としても登場しています。今回はそれらを使って、さまざまなポージングの可能性を探っていければなと思います。よろしくお願いいたします! 実験概要今回はスレッタちゃんに例のポーズを取ってもらう実験をしてみます。

プロンプトではほぼどう指定したものだか困ってしまう、例のポーズ…。ただ、Cannyやopenpose handを使ってこの輪郭をぶっこ抜くのは公式のi2iパクリとほぼ同じなので、それ以外の方法を使って再現するにはどうするのがよいか、実践していきたいと思います。

【@studiomasakaki】ツイッター投稿まとめ主なツイッター投稿やイラストです。フォローしておくといいことあるかも? 5000フォロワーありがとうございますわ~!毎日こんな楽しくて良いのかしら! pic.twitter.com/1WMmWhvWDr— 賢木イオ@スタジオ真榊 (@studiomasakaki) February 19, 2023 最適設定を探せ!「AbyssOrangeMix3」最速レビューこんばんは、スタジオ真榊です。本日、賢木も愛用している「AbyssOrangeMix」の最新バージョン、「AOM3」が公開されました!カワイイ、アーティスティック、そして遠慮のないエロと三拍子そろったAOM2は層別マージモデルの傑作だったわけですが、その進化形となる「AOM3」は一体どんなモデルなのか?さっそくレビューしたいと思います。 しかし、この界隈本当に進化のスピードが速すぎる!やることが…やることが多い…! 目次 AbyssOrangeMix2の振り返り 注意!AOM3は2/25現在、2と異なり生成画像の商用利用などが禁止されています。利用の際はこちらの記事「【注意喚起】使用モデルのライセンスを再確認しよう!」をご覧いただき、ライセンス表記をもう一度確認することをおすすめ致します。 【導入方法】ControlNet徹底解説!プロンプト苦難の時代が終わる…こんにちは、スタジオ真榊です。ここ数日はこの話題でもちきりですね。そう、拡張機能「ControlNet」の衝撃的デビューで、プロンプトやi2iでポーズや構図をなんとか表現しようと苦心していた時代は過去のものになりました。

Controlnetは、参照画像からキャラクターの四肢のボーンやイラストの主線、depth(深度情報)などさまざまな情報を抽出し、イラストのポーズや構図を自由に制御できる革新的な拡張機能です。2023年2月10日に論文が投稿されるや、わずか数日でStable Diffusion用WebUI向けの拡張機能が登場。当初は1つ5GB超えのモデルを8つダウンロードしなくてはなりませんでしたが、あっという間に一つ約700MB程度に圧縮され、容易に導入できるようになってしまいました。

単に構図やポーズを指定するだけでなく、イラストの主線や輪郭を保存して新たにイラストを生成しなおすことすら可能になったため、線画の着色やマウスで描いた落書きからのいきなり完成イラスト生成といったi2iではできなかったことが次々にできるようになっています。まさに革命!

さっそく今回は導入方法の解説とともに、各学習モデルの違いや使い方を解説していきたいと思います。 【この記事はFANBOX会員向け記事ですが、前半部分を無料公開します】

【ローカル版】エロ特化!最強プロンプト(呪文)新辞典★無料公開版★ブログの一番人気記事「エロもいける!最強プロンプト(呪文)辞典」に続き、本稿ではローカル環境における7thLayer系とOrangeMix系のプロンプトの効果を再調査し、分類しました。

NovelAIは現行学習モデルの中で最も自由度が高いモデルの一つとされ、構図や表現のプロンプト指示に非常に柔軟に反応してくれます。一方、後発のマージモデルはNAIよりも緻密なイラスト表現が可能になりますが、NAIと比べると頭が固く、視線誘導一つとっても指示が難しい傾向にあります。OrangeMix系、7thLayer系の学習モデルに、どう伝えたらNAIのように言うことを聞いてもらえるか、よりローカルに向いたクォリティータグはどんなものか…といった観点から、既存のプロンプト集を再編纂したのがこちらの「新辞典」になります。

学習モデルによってプロンプトの効果は全く異なりますが、別モデルをお使いの方にも何かのご参考になれば幸いです。

<★FANBOX用の記事ですが、ブログでは前半部分までを無料公開いたします。全文はこちらから★> |

|

copyright © 2024 ゲス顔イオナズン all rights reserved.