ゲス顔イオナズン

Stable Diffusion✕AIイラスト徹底解説!

アップスケール?描き直し?新モデル「Tile」ができることこんばんは、スタジオ真榊です。今夜は2023年4月25日付で完成したばかりのControlnet1.1用モデル「Tile」についての報告です。Controlnet1.1で使えるものの中でもひときわ異質なこのモデル。アップスケール用なのか?それともCannyやDepthのように構図を写し取るためのものなのか?いろいろと検証してみました。

※Controlnet全体についての基本的な使い方や各モデル紹介については、こちらの記事(▼)をご参照ください。

Tileってどんなモデル?Controlnet1.1が公開された当初、Tileは「未完成」という注釈つきのモデルでした。モデル一覧では「control_v11u_sd15_tile」が公開され、プリプロセッサ一覧には入力画像にガウスぼかしを掛ける「Tile gaussian」というものが掲載されていました。その後、2023年4月25日に「完成」がアナウンスされ、新たなモデルとして「control_v11f1e_sd15_tile」が公開。「Tile gaussian」は「tile resample」に姿を変た…という経緯があります。 一体、何ができるモデルなのか?公式に書かれている説明は下記のようなものです。

・このモデルはさまざまな方法で使用できますが、大きく分けて、次のような2 つの動作をします。 わかるような、わからないような。

例えば、64×64の小さな犬のアイコンをそのまま8倍の512×512にズームすると、

このようにぼやけてしまいます。 これは元画像のディティールが画像縮小の影響で失われてしまっているためですね。これを入力画像にしてi2iで高品質にしようとしても…

元画像の「低品質な細部」にひっぱられて、このように低品質な画像ができてしまいます。 Tileはこうした「低品質な細部」を無視しつつ、もとのアイコンの犬の全体の形を保ちながら、アイコンに存在しない詳細な毛並みに置き換えてくれるというものです。

こちらの画像をご覧ください。

これは、i2iではなくt2iで、先程の64x64pxの画像をTileで読み込ませて512x512で生成したもの。元画像になかったディティールが追加されていることが分かると思います。

「おお、じゃあこれ、アップスケール用のモデルなんですね?」と思うところですが、公式はあくまで「アップスケールもできるが、本来はディティールの置き換え(または追加)を行うモデル」だと念を押しています。

公式が提案する「Tileの使い方」は次の5つ。

①2倍、4倍、または8倍のアップスケールができる このうち、①のアップスケールについては、ほかのアップスケーラーのようにイラストを高解像度化するのではなく、「イラストに描かれたものを認識し、より高い解像度でゼロから描き直す」のだというのです。一体どういうことなのか?それを今回検証していきたいと思います。 Controlnetが理解る!モデル15種&プリプロセッサ35種を徹底解説★FANBOX記事の前半部分までを無料公開しています こんばんは、スタジオ真榊です。今回はStableDiffusionwebUIに大きな革命をもたらした拡張機能群「Controlnet」の大型解説記事です。2023年春に登場した「ver1.1」について、2023年4月27日時点で使用できるモデル14種とプリプロセッサ全35種のそれぞれの特徴とできることを検証しました。

Controlnetには、線画だけを抽出できる「Lineart」やポーズだけを抽出できる「Openpose」といったさまざまなモデルがあり、それらを有効に動かすための下ごしらえをする「プリプロセッサ(前処理機能)」というものが用意されています。

今回の記事は、それぞれの組み合わせやパラメータ設定、それによってできることなどを詳しく解説していく「総論」的な解説。「各論」に当たる各モデルの詳しい検証記事もリンクしてありますので、ぜひご活用ください。 目次インストール&アップデート方法 新モデル「inpaint」でイラストの続きを描いてもらおう!【Controlnet1.1検証】こんばんは、スタジオ真榊です。前回の「Pix2pixでイラストを変化!10種の実験で分かったこと」に引き続き、今回もControlnet1.1でできることを検証していきます。

今回紹介するのは、新モデル「inpaint」。これはその名の通り、マスクした部分を描き直すインペイント機能に特化したControlnetモデルです。とはいえ「image2image画面で通常のインペイントをするのとどう違うの?」というのが最初に覚える疑問。text2textの画面でどうやってインペイントすればいいのかも含め、何ができるようになったのかを検証していきましょう。

なお、この記事では、img2imgタブで利用する従来のinpaint機能を「i2iインペイント」、今回検証するcontrolnet1.1のモデルとしてのinpaintを「inpaintモデル」と呼んで区別することにします。 目次実験:髪色を変化させる 実験:服装を変化させる 実験:表情変化を試す

実験:崩壊した手を直せる?

実験:イラストの一部を消して置き換える

実験:続きを描いてもらう「outpaint」

「Pix2pix」でイラストを変化!10種の実験で分かったこと【Controlnet1.1検証】こんにちは、スタジオ真榊です。前回の記事に引き続き、今夜もControlnet1.1の新モデル検証の続きをお届けしたいと思います。

今回検証するのは「Pix2pix」。前回はイラストの要素をばらばらにして再構成する「Shuffle」について研究しましたが、Pix2pixは再構成ではなく「変化」を扱う新技術です。Controlnetのアップデートに注意しながら、さっそく見ていきましょう。

目次

・元イラストを変化させられる「Pix2pix」 ※今回の検証には一部、着衣状態の女の子を脱衣させる実験が含まれます。ご注意ください。

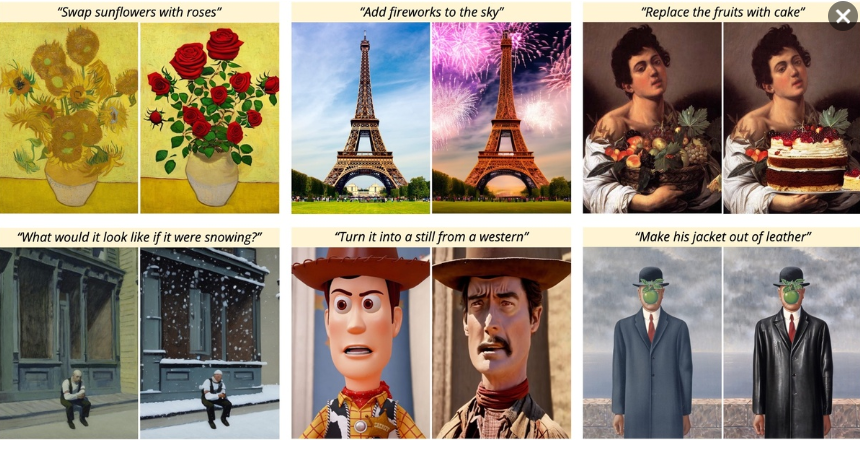

元イラストを変化させられる「Pix2pix」Pix2pixは「ペア」になった画像を教師データとして大量学習させることで、AIに二つの画像の間の「関係性」を覚えさせ、ある入力画像を渡すと指示通りに変化させて出力させられるようにする技術のこと。例えば、赤いリンゴの絵と青いリンゴの絵をペアで学習したAIは「Aを青くしたものがB」という関係性を学びますので、「このイチゴを青くして」という要求に応えられるようになる・・・というわけです。

こちらの例では、「ひまわりをバラに取り替える」「空に花火を加える」「果物をケーキに置き換える」といった指示プロンプトによって、その通りに画像が変化していることが分かります。

「ある画像を入力して別の画像に変換する」という意味ではShuffleに似ていますが、Shuffleがあくまで元画像をピースとしてパズルをくみ上げる「再構成」のイメージなのに対して、Pix2pixはあるお題を任意の状態に「変化」させるイメージ。Shuffleと違って元イラストの色合いや要素を必ずしも継承しないので、入力画像と出力画像の雰囲気が似ないこともありますし、変化させる対象(上の例なら花や空、コートなど)を限定して置き換えることもできます。

【Controlnet1.1検証】新モデル「Shuffle」でイラストを"再構成"しよう!はいこんばんは、スタジオ真榊です。前回の「Controlnet1.1爆誕!顔抽出&アニメ主線抽出&線画塗りを試してみた」に引き続き、今回もControlonet1.1の検証記事をお届けします。

これから検証するのは、「Shuffle」「Pix2Pix」「Inpaint」の新顔3種モデル。前回紹介した「新Openpose」と「LineartAnime」はControlnet1.0でもできたことの進化版という印象でしたが、新3種モデルはそれぞれ全く新しい概念をStableDiffusionに持ち込むモデルとなっています。

具体的には、

・「元画像を構成する要素を"シャッフル"して、全く異なる構図のイラストとして再構成する」(shuffle)

・「この画像をこう変化させてとAIに頼む」(pix2pix)

・「これまでのinpaint機能より正確な『描き直し』をする」(inpaint)

・・・ことが可能になります。

『何を言っているのかわからねーと思うが、おれも何をされたのかわからなかった…』状態に陥りますが、どれも直感的に分かりやすく、かつ画期的な機能。1記事に3種の検証結果はおさまりきらなかったので、まずは「Shuffle」から順番に見ていきましょう! Controlnet1.1爆誕!顔抽出&アニメ主線抽出&線画塗りを試してみたこんばんは、スタジオ真榊です。AIイラスト術天下一武道会の開催真っ最中ですが、Controlnet1.1がSDwebUIの拡張機能にぃ… きたー!!! というわけで、既に午前2時なのでかなり限定的な内容にはなりますが、前置きは全てすっ飛ばして最速でアプデ方法と注意点、使用感をお伝えしていきます。Check it out! 『AIイラスト術 天下一武道会』開催中!AIイラスト活用術についての有益記事が集まるスタジオ真榊初のイベント、『AIイラスト術 天下一武道会』を開催中です!エントリー作品はこちらの10作品。投票で最も支持を集めた優勝者には、AI術師界隈で最も人気を集めているグラフィックボード「GeForceRTX3060(VRAM12GB)」、もしくは3万円分のアマゾンギフト券が進呈される豪華イベントとなっております! エントリー作品は4月15日以降、毎日20時にFANBOXに更新されますので、みなさまぜひ御覧ください!10作品公開後は、FANBOX支援者の皆様による優勝予想ダービーを開催。優勝者を当てた方から抽選で1名様に、これまでの支援金と同額のアマゾンギフトカードが進呈されます!そちらもぜひお楽しみに~! Twitterのアルゴリズム判明!実験したらえらいことになった話こんばんは、スタジオ真榊です。前回はシャドウバンについて考察しましたが、本日もAI術師さん向けTwitter攻略術の続きということで、2023年3月31日にGithub上で公開されたツイートのおすすめアルゴリズムについての記事をお届けします。

公開されたソースコードを見た人たちからは、例えば「ツイート拡散の観点において、リプライは『いいね』の27倍の価値がある」とか「フォローしている人数がフォロワー人数より多いアカウントの投稿は拡散されにくくなる」といった情報が次々に投稿され、話題になっています。ただ、ソースコードをよく見てみると、どうも我々の投稿は、ちまたでよく言われているものとはちょっと違う仕組みで採点されていることがわかってきました。

そこで、いつもの実験を行うことにしました。「公開された情報を参考にしたら実際にバズることはできるのか?」ということで、非フォロワーに拡散されやすくなるという要素を研究し、全部盛りにしたツイートをしてみた結果がこちらです。 スタジオ真榊のアカウントでは、いきなり過去最も拡散されたツイートになってしまいました。あからさまに拡散を狙いに行ったツイートだったのでなかなか書いていて恥ずかしかったのですが、予想以上の結果だ…

そんなわけで、今回はアルゴリズムの内容を分かりやすく解説しながら、あくまでAI術師の観点から「どうしたら多くの人のTLに自分のAIイラスト投稿を表示できるのか?」または「なぜ自分のAIイラストはツイッターに拡散してもらえないのか?」ということを考える記事にしていきたいと思います。今回も長くなりますが、どうぞおつきあい下さい。 失敗しない!StableDiffusionWebUIを誰でもインストールできる方法こんばんは、スタジオ真榊です。今回は、初心者向けに改めてStableDiffusionWebUI(以下SDwebUI)をインストールする方法をコンパクトにまとめたHowto記事です。

AIイラストの初心者向け解説については「今から追いつく!AIイラスト超入門」に詳しくまとめてありますが、今回の記事はそちらでは省略した「SDwebUIを実際に動かすまで」の流れについて、PC知識のない方にも分かりやすく解説する内容となっています。

※ちなみに、【StableDiffusion導入解説】NovelAI中級者がローカル環境を導入したら別世界に突入した件ではgitとPythonを使ったインストール方法を紹介していますが、今回はより簡単なインストーラーを使った方法を解説します。イラストAI自体触るのが初めて!という方向けの記事です。

目次

AUTOMATIC1111版StableDiffusionWebUIとは?

必要なもの

推奨スペック

インストール方法

- 1.Stable Diffusion web UI本体を入手する

- 2.学習モデルを入手する

- 3.vaeを入手する

- 4.起動ファイルを修正する

- 5.アップデートで最新版にしよう

ついに実行

日本語化しよう

テスト生成してみよう

閉じ方と次回の起動方法

【前半無料公開】AI術師が陥るシャドウバン問題 7年ぶり解除までにやった10の対策【FANBOX向け記事ですが、このブログでは前半までを無料公開しています】 皆様こんにちは、スタジオ真榊です。今回は多くのAI術師さんたちを悩ませている、ツイッターの「シャドウバン」についての記事です。

スタジオ真榊のアカウントはAIイラストが生まれるずっと前から成人向けの活動を続けてきたので、開設した7年前からずっと検索に引っかからない状態だったのですが、いろいろと対策を講じた結果、無事解除されて検索にヒットするようになりました。当初は解除されたり、また見えなくなったりの繰り返しでしたが、3月中旬以降は常に検索にヒットする状態になっています。 シャドウバンが解除されるかどうかはAIイラストアカウントにとっては死活問題。普段通りの投稿ができなくなってしまったり、ツイッターから離れてしまったりした方をよくお見かけします。もちろん「こうすれば確実に解除できる」とまでは言えないのですが、「いつごろからどういった方策を講じ、どれくらいの期間を置いてどのように解除されたのか」を報告することはそれなりに有益かと考え、AI術師がシャドウバンされがちな理由の考察と合わせて記事にすることにしました。

「18禁イラストを投稿しているわけではないのにシャドウバン状態になってしまった」というAIユーザーさんにとって、この記事が何かの参考になれば幸いです。 目次 - シャドウバンとは - ツイッター側の主張

- シャドウバンの種類

- 日本におけるシャドウバンの実態と疑問

- AIイラストレーターに起きている現象

- 日本版シャドウバンの理由推測

- AIイラストレーターが対象になるのはなぜ?

- 「肌色BANなど存在しない」という反証

- シャドウバン解除のために試した10の対策

- 3月3日に突然解除

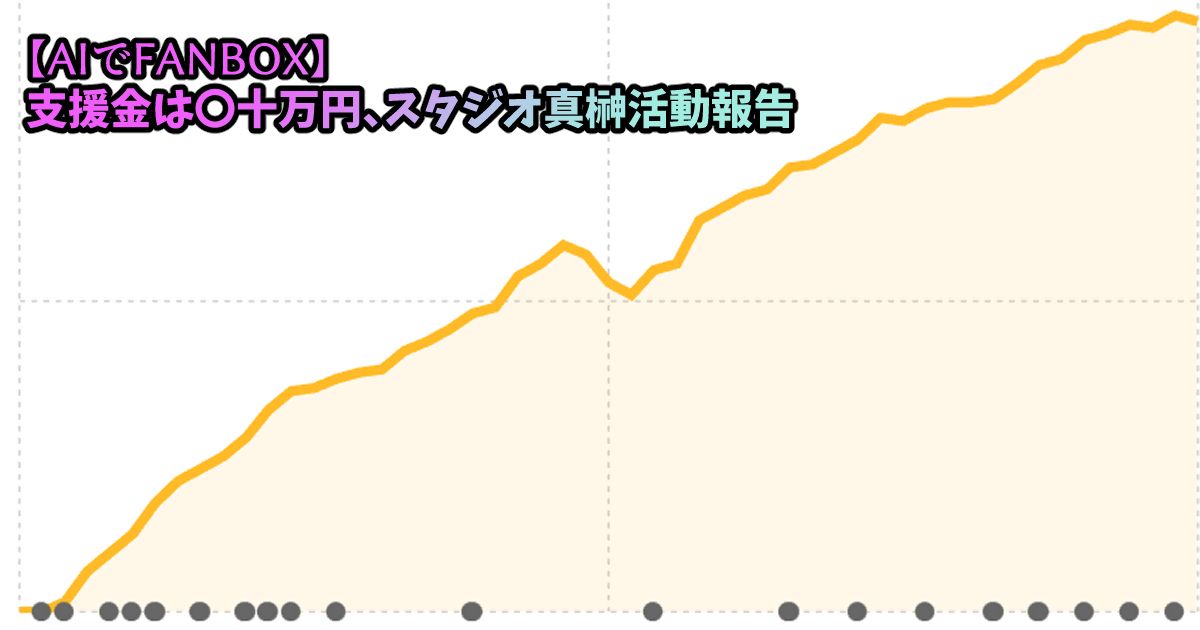

- 終わりに 「AIでラクに稼げる」は本当?FANBOX成功者は〇人に1人皆さまこんばんは、スタジオ真榊です。本日はPixivFANBOXの「お友達紹介キャンペーン」についてご報告があります。

ピクシブ社より通知があり、当FANBOXのキャンペーン欄からFANBOXに登録して条件を達成された方が、累計で10名に達したことが分かりました。開設から4カ月、どなたが達成したかは情報開示されないので分かりませんが、おめでとうございます!

また、当FANBOXのリンクから登録してくださったこと、ありがとうございました。キャンペーン達成の5000円は招待したスタジオ真榊側にも同額が支給されるので、現在エントリー募集中の「AIイラスト術天下一武道会」の賞品代に充てようと思います。

ちまたではよく「絵が描けなくても、画像生成AIを使えばFANBOXでラクに儲けられる」といった風評を耳にします。手元にあるのはごく限られた情報ではありますが、今回はキャンペーン条件達成を「FANBOXが軌道に乗った」=成功ととらえた場合、AIイラストにおいてそれは一体どれくらいの割合なのだろう?ということを考察してみたいと思います。 ダブルで便利!一発出し拡張機能を入れておこうこんばんは、スタジオ真榊です。今夜は「WebUIの便利機能をマスターしよう!」に引き続き、UI周りの拡張機能について紹介していきたいと思います。 ご紹介するのは「Aspect Ratio selector」と「Config-Presets」の2本立て。それぞれ、お気に入りのキャンバスサイズや各種生成設定を記憶しておいて一発出ししてくれる便利機能です!

WebUIに慣れれば慣れるほど、無駄な手間が省けるようになるのは嬉しいもの。便利UIをダブルで導入して、もっとスマートに画像生成しちゃいましょう! 「Latent Couple」が理解る!【第1回:基本マスター編】こんばんは、スタジオ真榊です。今回はStableDiffusionWebUIの拡張機能「Latent Couple」の解説記事第1回ということで、誰でも自由にキャンバスの分割ができるようになる「基礎マスター編」をお届けします。

画像生成AIが特に苦手なのが、要素の異なるキャラクターの「2ショット」ですよね。例えばピンクのショートヘアと緑のツインテールの女の子を生成しようとすると、どんなにプロンプトを工夫しても「緑のツインテール2人」が出たり、「両方ショートヘア」になってしまったり。こうした複数キャラのプロンプトの混線については、拡張機能「Cutoff」の解説記事でも扱ったばかりですが、Latent Coupleをうまく使いこなすと、混線を防ぐだけでなくキャンバス上のどこに何を描くかまでコントロールすることができるんです!

さらに、指定領域ごとに複数のLoRAを適用して別々のキャラクターを1枚のイラスト上に呼び出したり、Controlnetと組み合わせてポーズをつけたりといったことも可能になります。「Latent couple」+「Composable LoRA」+「Multi controlnet」でどんなことができるのか?…は次回の「応用編」に譲るとして、今回はまず基本的な使い方をマスターしましょう。 X/Y/Z plotで初めてのモデルと仲良くなろう!こんばんは、スタジオ真榊です。今夜はStableDiffusionWebUI上で生成結果の比較実験ができる機能「X/Y/Z plot」を使って、初めて使うcheckpoint(学習モデル)と仲良くなる方法について書いていきますよ。

ダウンロードしたばかりのモデルはどんなクォリティタグが効くのか、どんなステップやスケールにしたら自分好みのイラストが生成できるかが分からず、実力を活かしきれないままお蔵入りになってしまうことがよくあると思います。X/Y/Z plotとある裏技をうまく組み合わせると、外出中に全部の総当りを済ませて一番好みの組み合わせを探り当てることができるんです! 「X/Y/Zプロットは研究好きなマニア向け機能なんでしょ?」と思っていた方も、使い方さえ分かればとっても簡単・親切・便利な機能なので、ぜひこの機会に試してみてくださいね。 クォリティ爆上げ!アップスケールを覚えようアップスケールのやり方ってな…200種類あんねん。

さてこんばんは、スタジオ真榊です。今夜は、最近質問を頂くことが多い「アップスケール」について、さまざまな手法や具体的テクニックなどを紹介したいと思います。

アップスケールと言われると、text2image画面にある「高解像補助(hires.fix)」が思い浮かびますが、「あれって綺麗になるけど時間掛かるしすぐ破綻しちゃうんだよな・・・」と敬遠している人も多いのではないでしょうか。高精細化の手法には、hires.fix以外にも「i2iアップスケール」や「SDアップスケール」、拡張機能の「アルティメットSDアップスケール」「multidiffusionアップスケール」といった方法があり、目的によって使い分けることができます。controlnetと組み合わせて崩壊を防いだり、絵柄を変えて緻密化したりするテクニックもあるので、さっそく詳しく見ていきましょう。

【目次】 |

|

copyright © 2024 ゲス顔イオナズン all rights reserved.